隨著互聯網的發展,google、百度等搜索引擎讓我們獲取信息愈加方便。但需求總會不斷涌現,純粹地借助百度等收集信息是遠遠不夠的,因此編寫爬蟲爬取信息的重要性就越發凸顯。

比如有人為了炒股,專門爬取了多種股票信息;也有人為了分析房價,耗費時間和精力學習爬蟲后,爬了綠中介的數據。

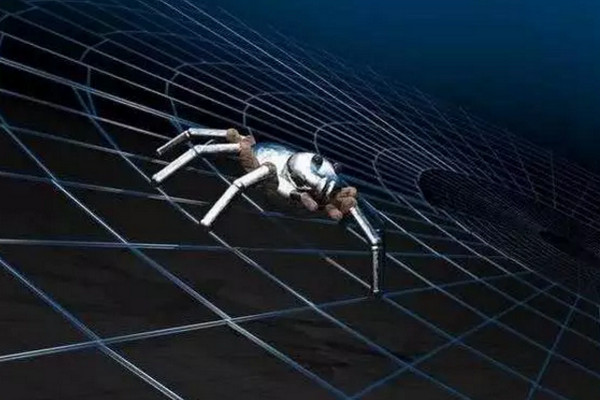

那么,爬蟲到底是什么呢?

網絡爬蟲,又名網頁蜘蛛,是一種按照一定的規則,自動地抓取萬維網信息的程序或者腳本。簡單的說,網絡爬蟲就是爬到對應網頁后把需要的信息搞下來的程序。

一般而言,若要成為一名爬蟲工程師,最低要求就是掌握Python、Java、Golang其中一種語言,還要對網絡編程、HTTP協議等了如指掌。

在當今這個大數據時代,網絡爬蟲作為網絡、存儲與機器學習等領域的交匯點,已經成為滿足個性化網絡數據需求的最佳實踐。那么到底如何學習爬蟲呢?

1、學習Python包并實現基本的爬蟲過程

大部分爬蟲都是按“發送請求——獲得頁面——解析頁面——抽取并儲存內容”這樣的流程來進行,這其實也是模擬了我們使用瀏覽器獲取網頁信息的過程。

Python中爬蟲相關的包很多:urllib、requests、bs4、scrapy、pyspider 等,建議從requests+Xpath 開始,requests 負責連接網站,返回網頁,Xpath 用于解析網頁,便于抽取數據。

2、掌握各種技巧,應對特殊網站的反爬措施

當然,爬蟲過程中也會經歷一些絕望,比如被封IP、比如各種奇怪的驗證碼、字體加密、userAgent訪問限制、各種動態加載等等。

遇到這些反爬蟲的手段,當然還需要一些高級的技巧來應對,常規的比如訪問頻率控制、使用代理IP池、字體反加密、抓包、驗證碼的OCR處理等等。

往往網站在高效開發和反爬蟲之間會偏向前者,這也為爬蟲提供了空間,掌握這些應對反爬蟲的技巧,絕大部分的網站已經難不到你了。

3、學習 scrapy,搭建工程化的爬蟲

掌握前面的技術一般量級的數據和代碼基本沒有問題了,接下來就要學習強大的 scrapy 框架了,它能幫助你應對非常復雜的情況。

scrapy 是一個功能非常強大的爬蟲框架,它不僅能便捷地構建request,還有強大的 selector 能夠方便地解析 response,然而它最讓人驚喜的還是它超高的性能,讓你可以將爬蟲工程化、模塊化。

學會 scrapy,你可以自己去搭建一些爬蟲框架,你就基本具備爬蟲工程師的思維了。

4、學習數據庫基礎,應對大規模數據存儲

爬回來的數據量小的時候,你可以用文檔的形式來存儲,一旦數據量大了,這就有點行不通了。所以掌握一種數據庫是必須的,比如MongoDB。

MongoDB 可以方便你去存儲一些非結構化的數據,比如各種評論的文本,圖片的鏈接等等。你也可以利用PyMongo,更方便地在Python中操作MongoDB。

因為這里要用到的數據庫知識其實非常簡單,主要是數據如何入庫、如何進行提取,在需要的時候再學習就行。

5、分布式爬蟲,實現大規模并發采集

爬取基本數據已經不是問題了,你的瓶頸會集中到爬取海量數據的效率。這個時候,相信你會很自然地接觸到“分布式爬蟲”。

分布式爬蟲其實就是利用多線程的原理讓多個爬蟲同時工作,需要你掌握 Scrapy + MongoDB + Redis 這三種工具。

Scrapy和MongoDB前面我們說過了,一個用于做基本的頁面爬取,一個用于存儲爬取的數據,Redis則用來存儲要爬取的網頁隊列,也就是任務隊列。

當你能夠寫分布式的爬蟲的時候,那么你可以去嘗試打造一些基本的爬蟲架構了,實現更加自動化的數據獲取。

對于小白來說,爬蟲可能是一件非常復雜、技術門檻很高的事情。但掌握正確的方法,在短時間內做到能夠爬取主流網站的數據,其實非常容易實現。希望上面這條學習路徑能幫助你快速入門。